ai-agents-for-beginners

(לחצו על התמונה למעלה כדי לצפות בסרטון של השיעור הזה)

Agentic RAG

השיעור הזה מספק סקירה מקיפה על Agentic Retrieval-Augmented Generation (Agentic RAG), פרדיגמה מתפתחת ב-AI שבה מודלים שפתיים גדולים (LLMs) מתכננים באופן אוטונומי את הצעדים הבאים שלהם בזמן שהם שולפים מידע ממקורות חיצוניים. בניגוד לדפוסים סטטיים של שליפה ואז קריאה, Agentic RAG כולל קריאות איטרטיביות ל-LLM, משולבות עם קריאות לכלים או לפונקציות ופלטים ממוסדים. המערכת מעריכה תוצאות, מחדדת שאילתות, מפעילה כלים נוספים במידת הצורך וממשיכה במחזור זה עד שמושגת תשובה מספקת.

Introduction

שיעור זה יכסה

- Understand Agentic RAG: למידה על הפרדיגמה המתפתחת ב-AI שבה מודלים שפתיים גדולים (LLMs) מתכננים באופן אוטונומי את הצעדים הבאים שלהם בזמן שהם שולפים מידע ממקורות נתונים חיצוניים.

- Grasp Iterative Maker-Checker Style: הבנת הלולאה של קריאות איטרטיביות ל-LLM, המשולבות עם קריאות לכלים או לפונקציות ופלטים ממוסדים, שמטרתן לשפר את הדיוק ולטפל בשאילתות פגומות.

- Explore Practical Applications: זיהוי תרחישים שבהם Agentic RAG מצטיין, כגון סביבות הדורשות נכונות קודם כל, אינטראקציות מורכבות עם מסדי נתונים ותהליכי עבודה ממושכים.

Learning Goals

לאחר השלמת שיעור זה, תדעו/תבינו כיצד:

- Understanding Agentic RAG: למידה על הפרדיגמה המתפתחת ב-AI שבה מודלים שפתיים גדולים (LLMs) מתכננים באופן אוטונומי את הצעדים הבאים שלהם בזמן שהם שולפים מידע ממקורות נתונים חיצוניים.

- Iterative Maker-Checker Style: הבנת המושג של לולאה של קריאות איטרטיביות ל-LLM, המשולבות עם קריאות לכלים או לפונקציות ופלטים ממוסדים, שמטרתן לשפר את הדיוק ולטפל בשאילתות פגומות.

- Owning the Reasoning Process: הבנת יכולת המערכת להיות בעלת בעלות על תהליך החשיבה שלה, ולבצע החלטות על אופן הגישה לבעיות ללא הסתמכות על מסלולים מוגדרים מראש.

- Workflow: הבנת האופן שבו מודל סוכני מחליט באופן עצמאי לשלוף דוחות מגמות שוק, לזהות נתוני מתחרים, לקשר מדדי מכירות פנימיים, לסנטז מסקנות ולהעריך את האסטרטגיה.

- Iterative Loops, Tool Integration, and Memory: למידה על התלות של המערכת בתבנית אינטראקציה לולאתית, שמירה על מצב וזיכרון בין השלבים כדי להימנע מלולאות חוזרות ולקבל החלטות מושכלות יותר.

- Handling Failure Modes and Self-Correction: חקר מנגנוני התיקון העצמי החזקים של המערכת, כולל איטרציה ושאילתות חוזרות, שימוש בכלי אבחון, ופנייה לפיקוח אנושי כגיבוי.

- Boundaries of Agency: הבנת המגבלות של Agentic RAG, עם דגש על אוטונומיה בתחום ספציפי, תלות בתשתית וכיבוד אמצעי שמירה.

- Practical Use Cases and Value: זיהוי תרחישים שבהם Agentic RAG מצטיין, כגון סביבות הדורשות נכונות קודם כל, אינטראקציות מורכבות עם מסדי נתונים ותהליכי עבודה ממושכים.

- Governance, Transparency, and Trust: למידה על חשיבות הממשל ושקיפות, כולל הסברת ההסקה, בקרה על הטיה ופיקוח אנושי.

What is Agentic RAG?

Agentic Retrieval-Augmented Generation (Agentic RAG) היא פרדיגמה מתפתחת ב-AI שבה מודלים שפתיים גדולים (LLMs) מתכננים באופן אוטונומי את הצעדים הבאים שלהם בזמן שהם שולפים מידע ממקורות חיצוניים. בניגוד לדפוסים סטטיים של שליפה ואז קריאה, Agentic RAG כולל קריאות איטרטיביות ל-LLM, המשולבות עם קריאות לכלים או לפונקציות ופלטים ממוסדים. המערכת מעריכה תוצאות, מחדדת שאילתות, מפעילה כלים נוספים במידת הצורך וממשיכה במחזור זה עד שהיא משיגה פתרון מספק. סגנון “יוצר-בודק” איטרטיבי זה משפר את הנכונות, מטפל בשאילתות פגומות ומבטיח תוצאות באיכות גבוהה.

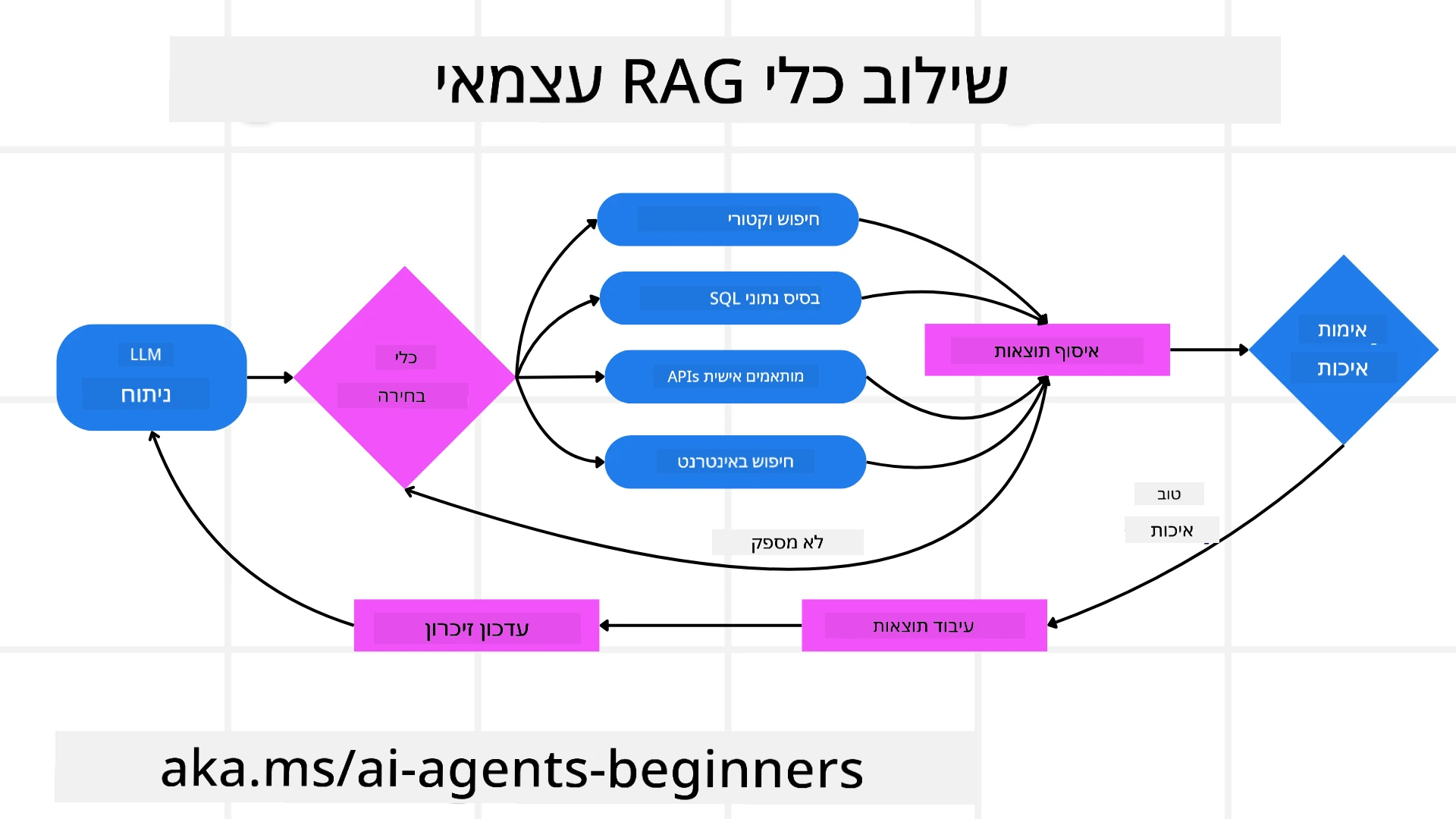

המערכת בעלת בעלות פעילה על תהליך ההסקה שלה, כותבת מחדש שאילתות שנכשלו, בוחרת שיטות שליפה שונות ומשלבת כמה כלים—כמו חיפוש וקטורי ב-Azure AI Search, מסדי נתונים SQL, או APIs מותאמים—לפני שהיא מסכמת את תשובתה הסופית. המאפיין המבדיל של מערכת סוכנית הוא היכולת שלה להיות בעלת בעלות על תהליך ההסקה שלה. יישומי RAG מסורתיים נשענים על מסלולים מוגדרים מראש, אך מערכת סוכנית קובעת באופן אוטונומי את רצף הצעדים על בסיס איכות המידע שהיא מוצאת.

Defining Agentic Retrieval-Augmented Generation (Agentic RAG)

Agentic Retrieval-Augmented Generation (Agentic RAG) היא פרדיגמה מתפתחת בפיתוח AI שבה LLMs לא רק שולפים מידע ממקורות חיצוניים אלא גם מתכננים באופן אוטונומי את הצעדים הבאים שלהם. בניגוד לדפוסים סטטיים של שליפה ואז קריאה או רצפי פרומפטים כתובים בקפידה, Agentic RAG מערב לולאה של קריאות איטרטיביות ל-LLM, המשולבות עם קריאות לכלים או לפונקציות ופלטים ממוסדים. בכל שלב, המערכת מעריכה את התוצאות שהשיגה, מחליטה האם לחדד את השאילתות שלה, מפעילה כלים נוספים במידת הצורך וממשיכה במחזור זה עד שהיא משיגה פתרון מספק.

סגנון הפעולה ה”איטרטיבי” של “יוצר-בודק” נועד לשפר את הנכונות, לטפל בשאילתות פגומות למסדי נתונים ממוסדים (למשל NL2SQL), ולהבטיח תוצאות מאוזנות ובאיכות גבוהה. במקום להסתמך אך ורק על שרשראות פרומפט מהונדסות בקפידה, המערכת בעלת בעלות פעילה על תהליך ההסקה שלה. היא יכולה לכתוב מחדש שאילתות שנכשלו, לבחור שיטות שליפה שונות ולשלב מספר כלים—כמו חיפוש וקטורי ב-Azure AI Search, מסדי נתונים SQL או APIs מותאמים—לפני שהיא מסיימת את התשובה שלה. זה מסיר את הצורך במסגרת אורכסטרציה מורכבת מדי. במקום זאת, לולאה פשוטה יחסית של “קריאת LLM → שימוש בכלי → קריאת LLM → …” יכולה לייצר פלטים מתוחכמים ומבוססים היטב.

Owning the Reasoning Process

המאפיין המבדיל שהופך מערכת ל”סוכנית” הוא היכולת שלה להיות בעלת בעלות על תהליך ההסקה שלה. יישומי RAG מסורתיים לעיתים קרובות תלויים בכך שבני אדם יגדירו מראש מסלול עבור המודל: שרשרת מחשבה שמפרטת מה לשלוף ומתי. אבל כאשר מערכת היא באמת סוכנית, היא מחליטה באופן פנימי כיצד לגשת לבעיה. היא לא רק מבצעת תסריט; היא מגדירה באופן אוטונומי את רצף הצעדים על בסיס איכות המידע שהיא מוצאת. לדוגמה, אם מבקשים ממנה ליצור אסטרטגיית השקת מוצר, היא לא תסתמך אך ורק על פרומפט שמפרט את כל סביבת המחקר וקבלת ההחלטות. במקום זאת, המודל הסוכני מחליט באופן עצמאי כדי:

- Retrieve current market trend reports using Bing Web Grounding

- Identify relevant competitor data using Azure AI Search.

- Correlate historical internal sales metrics using Azure SQL Database.

- Synthesize the findings into a cohesive strategy orchestrated via Azure OpenAI Service.

- Evaluate the strategy for gaps or inconsistencies, prompting another round of retrieval if necessary. כל שלב מהשלבים האלה—מחדוד שאילתות, בחירת מקורות, איטרציה עד ש”מסופק” עם התשובה—מוחלט על ידי המודל, לא כתוב מראש על ידי אדם.

Iterative Loops, Tool Integration, and Memory

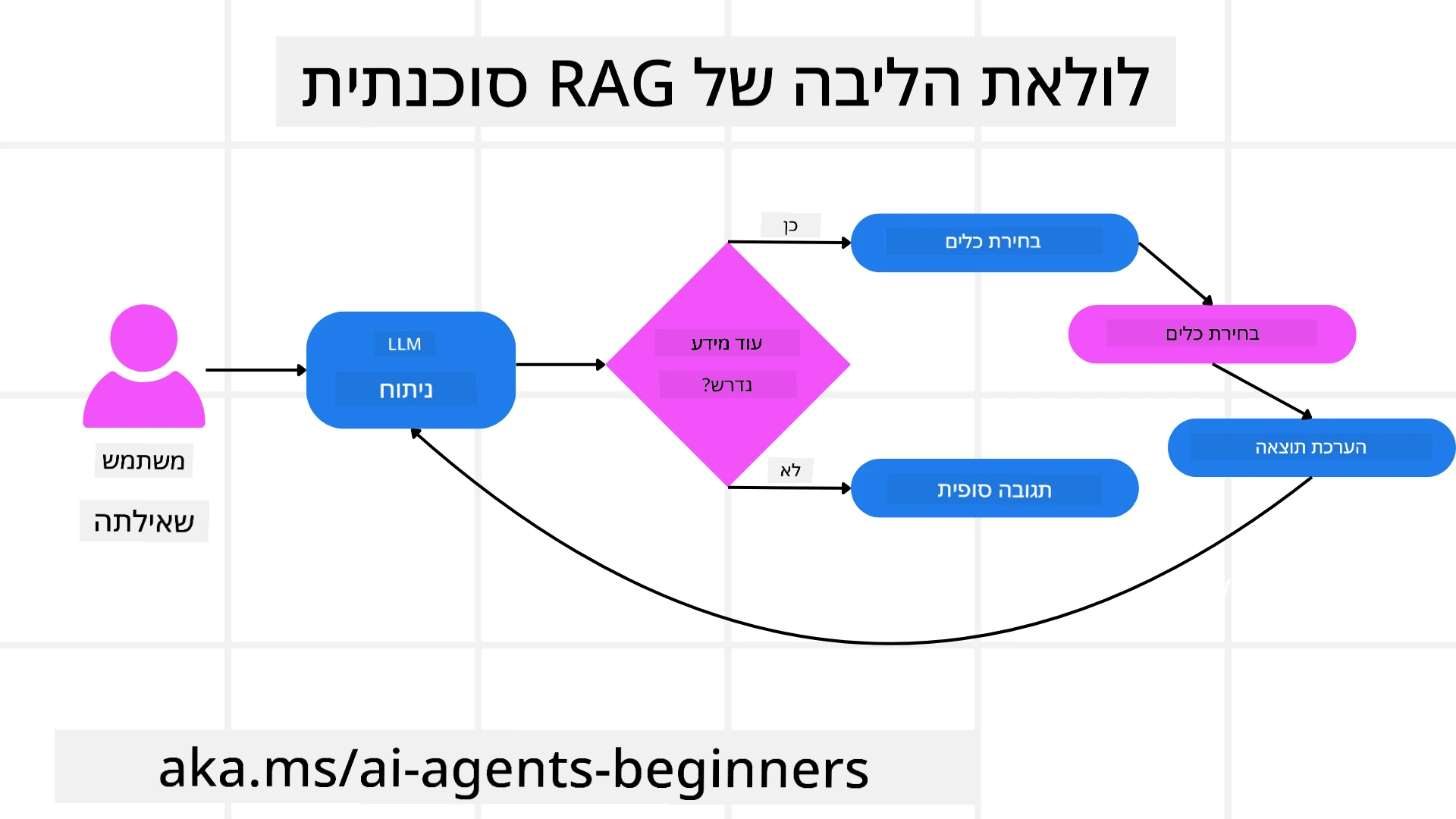

מערכת סוכנית מסתמכת על דפוס אינטראקציה לולאתי:

- Initial Call: מטרה של המשתמש (המכונה גם “הנחיית המשתמש”) מוצגת ל-LLM.

- Tool Invocation: אם המודל מזהה מידע חסר או הוראות לא ברורות, הוא בוחר כלי או שיטת שליפה—כמו שאילתה למסד נתונים וקטורי (למשל חיפוש היברידי של Azure AI Search על נתונים פרטיים) או קריאת SQL ממוסדת—כדי לאסוף הקשר נוסף.

- Assessment & Refinement: לאחר סקירת הנתונים שהוחזרו, המודל מחליט האם המידע מספיק. אם לא, הוא מחדד את השאילתה, מנסה כלי אחר או משנה את הגישה שלו.

- Repeat Until Satisfied: מחזור זה ממשיך עד שהמודל קובע שיש לו די בהירות וראיות כדי לספק תשובה סופית ומנומקת.

- Memory & State: מכיוון שהמערכת שומרת מצב וזיכרון לאורך השלבים, היא יכולה להזכיר ניסיונות קודמים ותוצאותיהם, להימנע מלולאות חוזרות ולקבל החלטות מושכלות יותר במהלך ההתקדמות.

במהלך הזמן, זה יוצר תחושת הבנה מתפתחת, מה שמאפשר למודל לנווט במשימות מורכבות רב-שלביות מבלי לדרוש מהאדם להתערב באופן מתמיד או לעצב מחדש את הפרומפט.

Handling Failure Modes and Self-Correction

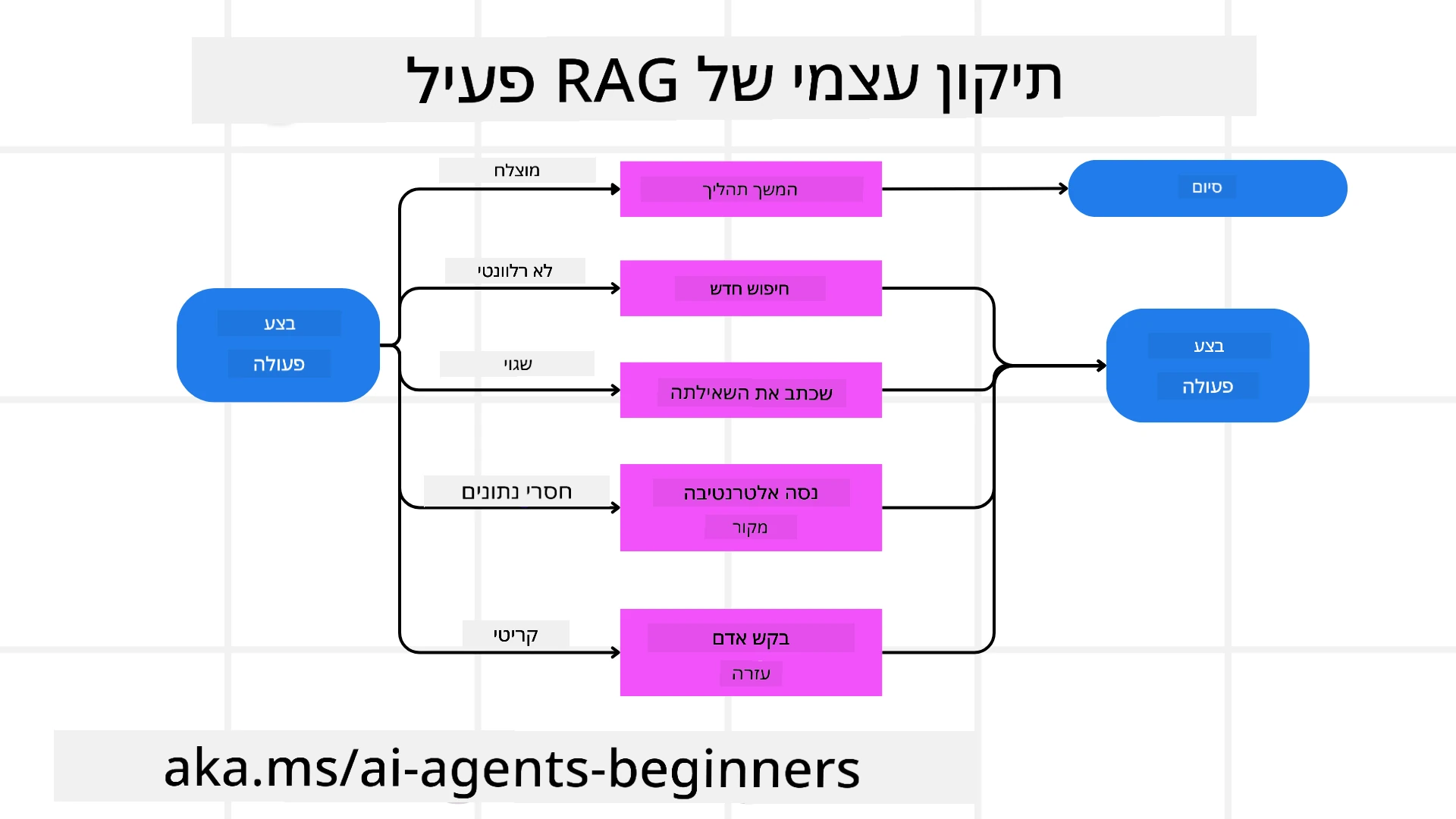

האוטונומיה של Agentic RAG כוללת גם מנגנוני תיקון עצמי חזקים. כשהמערכת נתקעת במבואות ללא מוצא—כגון שליפה של מסמכים לא רלוונטיים או התקלות בשאילתות פגומות—היא יכולה:

- Iterate and Re-Query: במקום להחזיר תשובות בעלות ערך נמוך, המודל מנסה אסטרטגיות חיפוש חדשות, כותב מחדש שאילתות למסדי נתונים, או בוחן מערכי נתונים חלופיים.

- Use Diagnostic Tools: המערכת עשויה להפעיל פונקציות נוספות שנועדו לעזור לה לאבחן את שלבי ההסקה שלה או לאשר את נכונות הנתונים שנשלפו. כלים כמו Azure AI Tracing יהיו חשובים כדי לאפשר נצפות וניתור חזקים.

- Fallback on Human Oversight: במצבים בעלי סיכון גבוה או במקרה של כישלון חוזר, המודל עשוי לסמן אי-ודאות ולבקש הנחיה אנושית. ברגע שהאדם מספק משוב מתקנן, המודל יכול לשלב את הלקח הזה להמשך.

גישה איטרטיבית ודינמית זו מאפשרת למודל להשתפר באופן רציף, ומבטיחה שהוא לא רק מערכת של ניסיון אחד אלא מערכת שלומדת מהטעויות שלה במהלך כל סשן.

Boundaries of Agency

למרות האוטונומיה בתוך משימה, Agentic RAG אינו שקול ל-Artificial General Intelligence. היכולות ה”סוכניות” שלה מוגבלות לכלים, למקורות הנתונים ולמדיניות שהוספקו על ידי מפתחים אנושיים. היא אינה יכולה להמציא כלים משלה או לצאת מעבר לגבולות התחום שנקבעו. במקום זאת, היא מצטיינת בתזמור דינמי של המשאבים הזמינים. הבדלים עיקריים מצורות AI מתקדמות יותר כוללים:

- Domain-Specific Autonomy: מערכות Agentic RAG מתמקדות בהשגת יעדי משתמש בתחום ידוע, ומשתמשות באסטרטגיות כמו כתיבת שאילתות מחדש או בחירת כלים כדי לשפר תוצאות.

- Infrastructure-Dependent: היכולות של המערכת תלויות בכלים ובנתונים שאינטגרו המפתחים. היא אינה יכולה לחרוג מהמגבלות הללו ללא התערבות אנושית.

- Respect for Guardrails: קווים מנחים אתיים, כללי תאימות ומדיניות עסקית נשארים חשובים מאוד. חופש הפעולה של הסוכן תמיד מוגבל על ידי אמצעי שמירה ומנגנוני פיקוח (מקווים כן?).

Practical Use Cases and Value

Agentic RAG מצטיין בתרחישים שדורשים חידוד איטרטיבי ודיוק:

- Correctness-First Environments: בבדיקות תאימות, ניתוח רגולטורי או מחקר משפטי, המודל הסוכני יכול לאמת עובדות שוב ושוב, להתייעץ במספר מקורות ולכתוב שאילתות מחדש עד שייצור תשובה שעברה ביקורת מעמיקה.

- Complex Database Interactions: כאשר עובדים עם נתונים ממוסדים שבהם שאילתות עלולות להיכשל או להזדקק להתאמה תכופה, המערכת יכולה לחדד את השאילתות באופן אוטונומי באמצעות Azure SQL או Microsoft Fabric OneLake, ולהבטיח שהשליפה הסופית תתאים לכוונת המשתמש.

- Extended Workflows: סשנים ארוכי-טווח עשויים להתפתח ככל שמידע חדש מתגלה. Agentic RAG יכול לשלב נתונים חדשים באופן רציף, לשנות אסטרטגיות ככל שהוא לומד יותר על מרחב הבעיה.

Governance, Transparency, and Trust

ככל שמערכות אלו הופכות ליותר אוטונומיות בתהליך ההסקה שלהן, ממשל ושקיפות הם קריטיים:

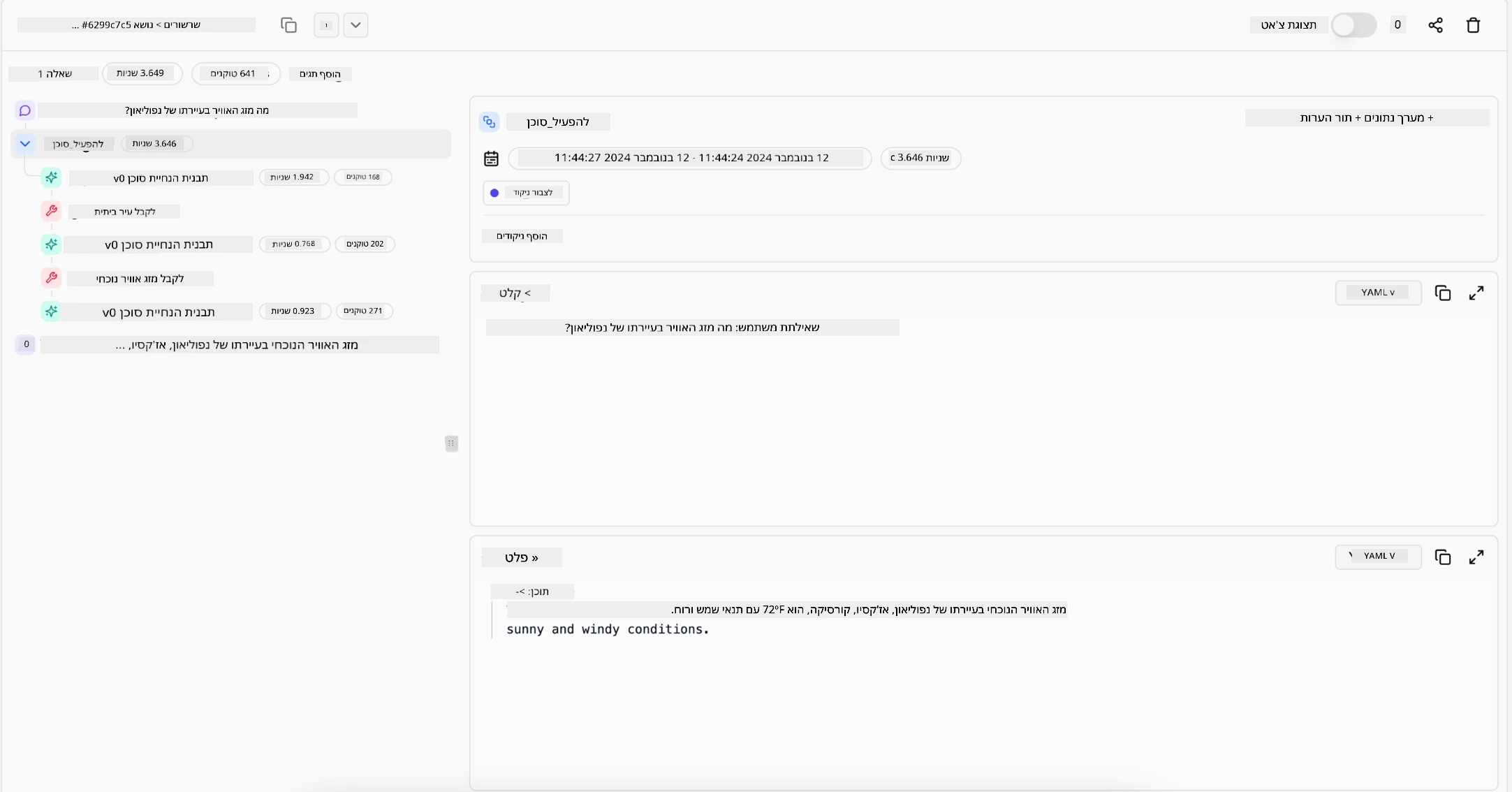

- Explainable Reasoning: המודל יכול לספק מסלול ביקורת של השאילתות שביצע, המקורות שהתייעץ בהם ושלבי ההסקה שלקח כדי להגיע למסקנה. כלים כמו Azure AI Content Safety ו-Azure AI Tracing / GenAIOps יכולים לעזור לשמור על שקיפות ולהפחית סיכונים.

- Bias Control and Balanced Retrieval: מפתחים יכולים לכוונן אסטרטגיות שליפה כדי להבטיח ששקולים ומקורות מייצגים נלקחים בחשבון, ולבצע ביקורת תקופתית על הפלטים כדי לאתר הטיות או דפוסים מעוותים באמצעות מודלים מותאמים לארגוני מדעי נתונים מתקדמים המשתמשים ב-Azure Machine Learning.

- Human Oversight and Compliance: עבור משימות רגישות, ביקורת אנושית נשארת חיונית. Agentic RAG אינו מחליף את השיפוט האנושי בהחלטות בעלות סיכון גבוה—הוא משפר אותו על ידי הצעת אפשרויות שנבדקו לעומק.

כלי שמספקים רישום ברור של הפעולות הם חיוניים. בלעדיהם, איתור תקלות בתהליך רב-שלבי יכול להיות קשה מאוד. ראו את הדוגמה הבאה מ-Literal AI (החברה שמאחורי Chainlit) עבור הרצת Agent:

Conclusion

Agentic RAG מייצג אבולוציה טבעית באופן שבו מערכות AI מטפלות במשימות מורכבות ותובעניות מבחינת נתונים. על ידי אימוץ דפוס אינטראקציה לולאתי, בחירה אוטונומית של כלים וחדוש שאילתות עד להשגת תוצאה איכותית, המערכת חורגת מעבר לעקיבות פרומפט סטטית והופכת לקבלת החלטות מותאמת להקשר. בעוד שהיא עדיין מוגבלת לתשתיות ולהנחיות אתיות שנקבעו על ידי בני אדם, יכולות הסוכנות הללו מאפשרות אינטראקציות AI עשירות יותר, דינמיות ושימושיות יותר הן עבור ארגונים והן עבור משתמשי קצה.

Got More Questions about Agentic RAG?

הצטרפו ל-Discord של Microsoft Foundry כדי לפגוש לומדים אחרים, להשתתף בשעות משרדיות ולקבל תשובות על שאלותיכם בנוגע ל-AI Agents.

Additional Resources

- יישום Retrieval Augmented Generation (RAG) עם שירות Azure OpenAI: למד כיצד להשתמש בנתונים שלך עם שירות Azure OpenAI. מודול Microsoft Learn זה מספק מדריך מקיף ליישום RAG

- הערכת יישומי בינה גנרטיבית עם Microsoft Foundry: מאמר זה מכסה את ההערכה וההשוואה של מודלים על מערכי נתונים זמינים לציבור, כולל יישומי Agentic AI וארכיטקטורות RAG

- מהו Agentic RAG | Weaviate

- Agentic RAG: מדריך מלא ל-Agentic Retrieval Augmented Generation מבוסס סוכנים – חדשות מ-generation RAG

- Agentic RAG: האץ את ה-RAG שלך באמצעות ניסוח מחדש של שאילתות ושאילתת-עצמי! ספר הבישול בקוד פתוח של Hugging Face לבינה מלאכותית

- הוספת שכבות Agentic ל-RAG

- עתיד עוזרי הידע: Jerry Liu

- כיצד לבנות מערכות Agentic RAG

- שימוש ב-Microsoft Foundry Agent Service להרחבת הסוכנים המלאכותיים שלך

מאמרים אקדמיים

- 2303.17651 Self-Refine: שיפור איטרטיבי באמצעות משוב עצמי

- 2303.11366 Reflexion: סוכני שפה עם למידת חיזוק מילולית

- 2305.11738 CRITIC: מודלים לשפה גדולים יכולים לתקן עצמם באמצעות ביקורת אינטראקטיבית עם כלים

- 2501.09136 Agentic Retrieval-Augmented Generation: סקירה על Agentic RAG

שיעור קודם

השיעור הבא

הצהרת אחריות: מסמך זה תורגם באמצעות שירות תרגום מבוסס בינה מלאכותית Co-op Translator (https://github.com/Azure/co-op-translator). למרות שאנו שואפים לדיוק, יש לשים לב שתרגומים אוטומטיים עלולים להכיל שגיאות או אי־דיוקים. המסמך המקורי בשפת המקור שלו צריך להיחשב כמקור הסמכות. למידע קריטי מומלץ להיעזר בתרגום מקצועי שנעשה על ידי מתרגם אנושי. איננו אחראים לכל אי־הבנות או לפרשנויות שגויות הנובעות מהשימוש בתרגום זה.