ai-agents-for-beginners

(اوپر دی گئی تصویر پر کلک کرکے اس سبق کا ویڈیو دیکھیں)

Agentic RAG

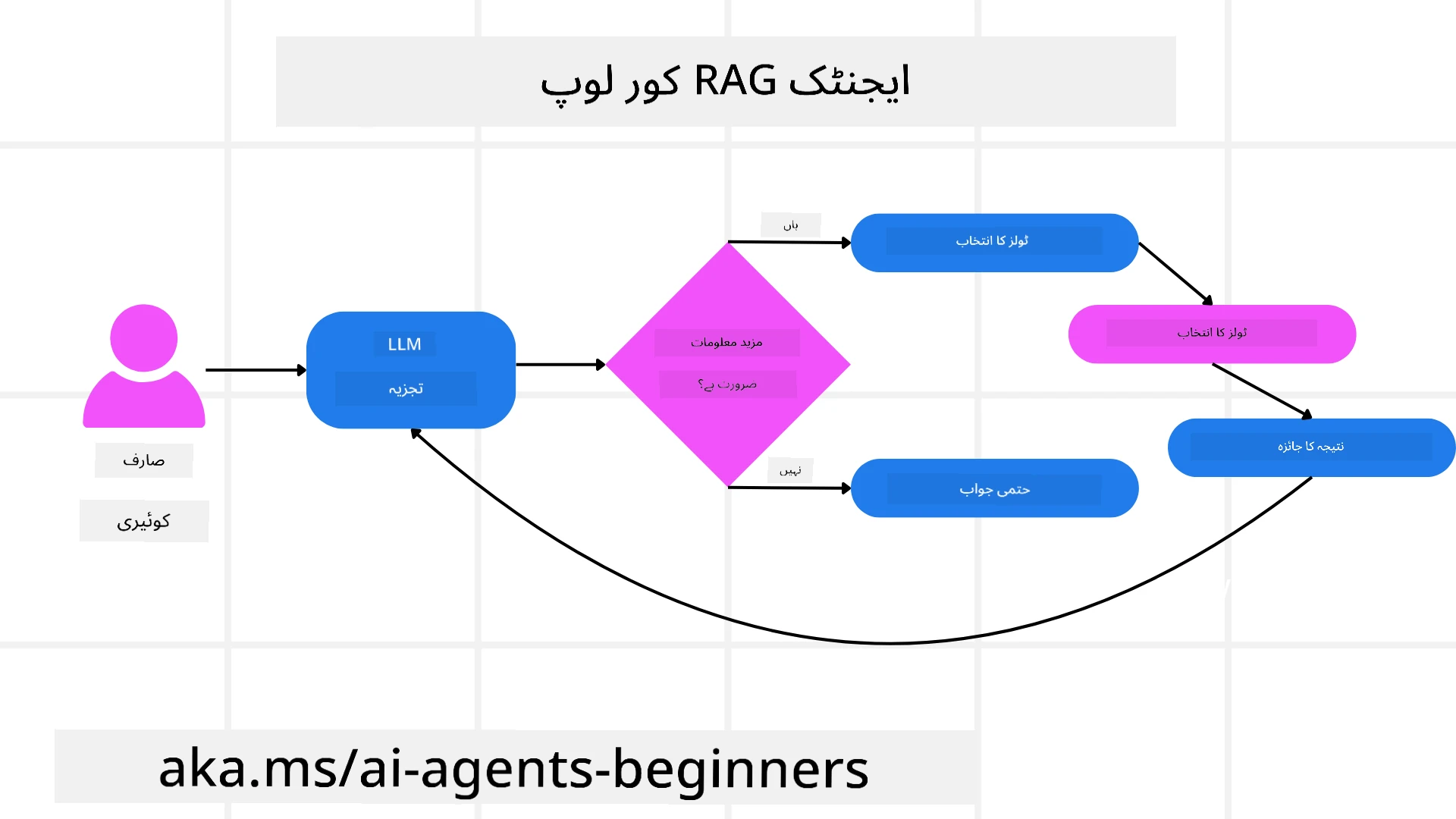

یہ سبق Agentic Retrieval-Augmented Generation (Agentic RAG) کا جامع جائزہ فراہم کرتا ہے، جو ایک ابھرتا ہوا AI پیراڈائم ہے جس میں بڑے لینگویج ماڈلز (LLMs) خود مختار طریقے سے اپنے اگلے اقدامات کی منصوبہ بندی کرتے ہیں جبکہ بیرونی ذرائع سے معلومات حاصل کرتے ہیں۔ جامد retrieval-then-read پیٹرن سے مختلف، Agentic RAG میں LLM کو تکراری طور پر کالز دی جاتی ہیں، جن کے بیچ ٹولز یا فنکشن کالز اور ساختی آؤٹ پٹس شامل ہوتے ہیں۔ سسٹم نتائج کا جائزہ لیتا ہے، سوالات کو بہتر بناتا ہے، ضرورت پڑنے پر اضافی ٹولز کو متحرک کرتا ہے، اور اس سائیکل کو تب تک جاری رکھتا ہے جب تک کہ اطمینان بخش حل حاصل نہ ہو جائے۔

تعارف

اس سبق میں درج ذیل شامل ہوں گے

- Agentic RAG کو سمجھیں: AI میں اس ابھرتے ہوئے پیراڈائم کے بارے میں جانیں جہاں بڑے لینگویج ماڈلز (LLMs) خود مختار طریقے سے اپنے اگلے اقدامات کی منصوبہ بندی کرتے ہیں جبکہ بیرونی ڈیٹا ذرائع سے معلومات حاصل کرتے ہیں۔

- تکراری Maker-Checker انداز کو سمجھیں: LLM کو تکراری طور پر کالز دیے جانے کے لوپ کو سمجھیں، جن کے بیچ ٹول یا فنکشن کالز اور ساختی آؤٹ پٹس شامل ہوتے ہیں، جس کا مقصد درستگی کو بہتر بنانا اور خراب شدہ سوالات کو سنبھالنا ہے۔

- عملی اطلاقات کی دریافت کریں: ان منظرناموں کی نشاندہی کریں جہاں Agentic RAG بہترین کارکردگی دکھاتا ہے، جیسے correctness-first ماحول، پیچیدہ ڈیٹا بیس تعاملات، اور طویل ورک فلو۔

سیکھنے کے اہداف

اس سبق کو مکمل کرنے کے بعد آپ یہ جانیں گے/سمجھیں گے:

- Agentic RAG کو سمجھنا: AI میں اس ابھرتے ہوئے پیراڈائم کے بارے میں جانیں جہاں بڑے لینگویج ماڈلز (LLMs) خود مختار طریقے سے اپنے اگلے اقدامات کی منصوبہ بندی کرتے ہیں جبکہ بیرونی ڈیٹا ذرائع سے معلومات حاصل کرتے ہیں۔

- تکراری Maker-Checker انداز: LLM کو تکراری طور پر کالز دیے جانے کے لوپ کے تصور کو سمجھیں، جن کے بیچ ٹول یا فنکشن کالز اور ساختی آؤٹ پٹس شامل ہوتے ہیں، جس کا مقصد درستگی کو بہتر بنانا اور خراب شدہ سوالات کو سنبھالنا ہے۔

- منطق کے عمل کا مالک ہونا: سسٹم کی اس صلاحیت کو سمجھیں کہ وہ اپنے استدلالی عمل کا مالک بنتا ہے، مسائل کے حل کے لیے پہلے سے طے شدہ راستوں پر منحصر ہونے کے بغیر فیصلے لیتا ہے۔

- ورک فلو: سمجھیں کہ ایک agentic ماڈل کیسے خود مختار طور پر مارکیٹ ٹرینڈ رپورٹس حاصل کرنے، حریف کے ڈیٹا کی شناخت کرنے، اندرونی سیلز میٹرکس کو جوڑنے، نتائج کو یکجا کرنے، اور اسٹریٹیجی کا جائزہ لینے کا فیصلہ کرتا ہے۔

- تکراری لوپس، ٹول انضمام، اور میموری: سیکھیں کہ سسٹم کس طرح لوپڈ انٹرایکشن پیٹرن پر مبنی ہوتا ہے، اقدامات کے درمیان ریاست اور میموری برقرار رکھتا ہے تاکہ بار بار دہرانے سے بچا جا سکے اور معلوماتی فیصلے کیے جا سکیں۔

- ناکامی کے موڈز اور خود درستگی کو سنبھالنا: سسٹم کے مضبوط خود درستگی میکانزمز کا مطالعہ کریں، بشمول تکرار اور دوبارہ استفسار کرنا، تشخیصی ٹولز استعمال کرنا، اور انسانی نگرانی پر واپس آنا۔

- ایجنسی کی حدیں: Agentic RAG کی حدود کو سمجھیں، جس میں ڈومین مخصوص خود مختاری، انفراسٹرکچر پر انحصار، اور گارڈ ریلز کا احترام شامل ہیں۔

- عملی استعمال کے معاملات اور قدر: ان منظرناموں کی نشاندہی کریں جہاں Agentic RAG بہترین کام کرتا ہے، جیسے correctness-first ماحول، پیچیدہ ڈیٹا بیس تعاملات، اور طویل ورک فلو۔

- گورننس، شفافیت، اور اعتماد: گورننس اور شفافیت کی اہمیت کے بارے میں جانیں، بشمول قابل وضاحت استدلال، تعصب کنٹرول، اور انسانی نگرانی۔

Agentic RAG کیا ہے؟

Agentic Retrieval-Augmented Generation (Agentic RAG) ایک ابھرتا ہوا AI پیراڈائم ہے جہاں بڑے لینگویج ماڈلز (LLMs) خود مختار طریقے سے اپنے اگلے اقدامات کی منصوبہ بندی کرتے ہیں جبکہ بیرونی ذرائع سے معلومات حاصل کرتے ہیں۔ جامد retrieval-then-read پیٹرن سے مختلف، Agentic RAG میں LLM کو تکراری طور پر کالز دی جاتی ہیں، جن کے بیچ ٹول یا فنکشن کالز اور ساختی آؤٹ پٹس شامل ہوتے ہیں۔ سسٹم حاصل کردہ نتائج کا جائزہ لیتا ہے، سوالات کو بہتر بناتا ہے، ضرورت پڑنے پر اضافی ٹولز کو متحرک کرتا ہے، اور اس سائیکل کو اس وقت تک جاری رکھتا ہے جب تک کہ اطمینان بخش حل حاصل نہ ہو۔ یہ تکراری “maker-checker” انداز درستگی کو بہتر بناتا ہے، خراب شدہ سوالات کو سنبھالتا ہے، اور اعلیٰ معیار کے نتائج کو یقینی بناتا ہے۔

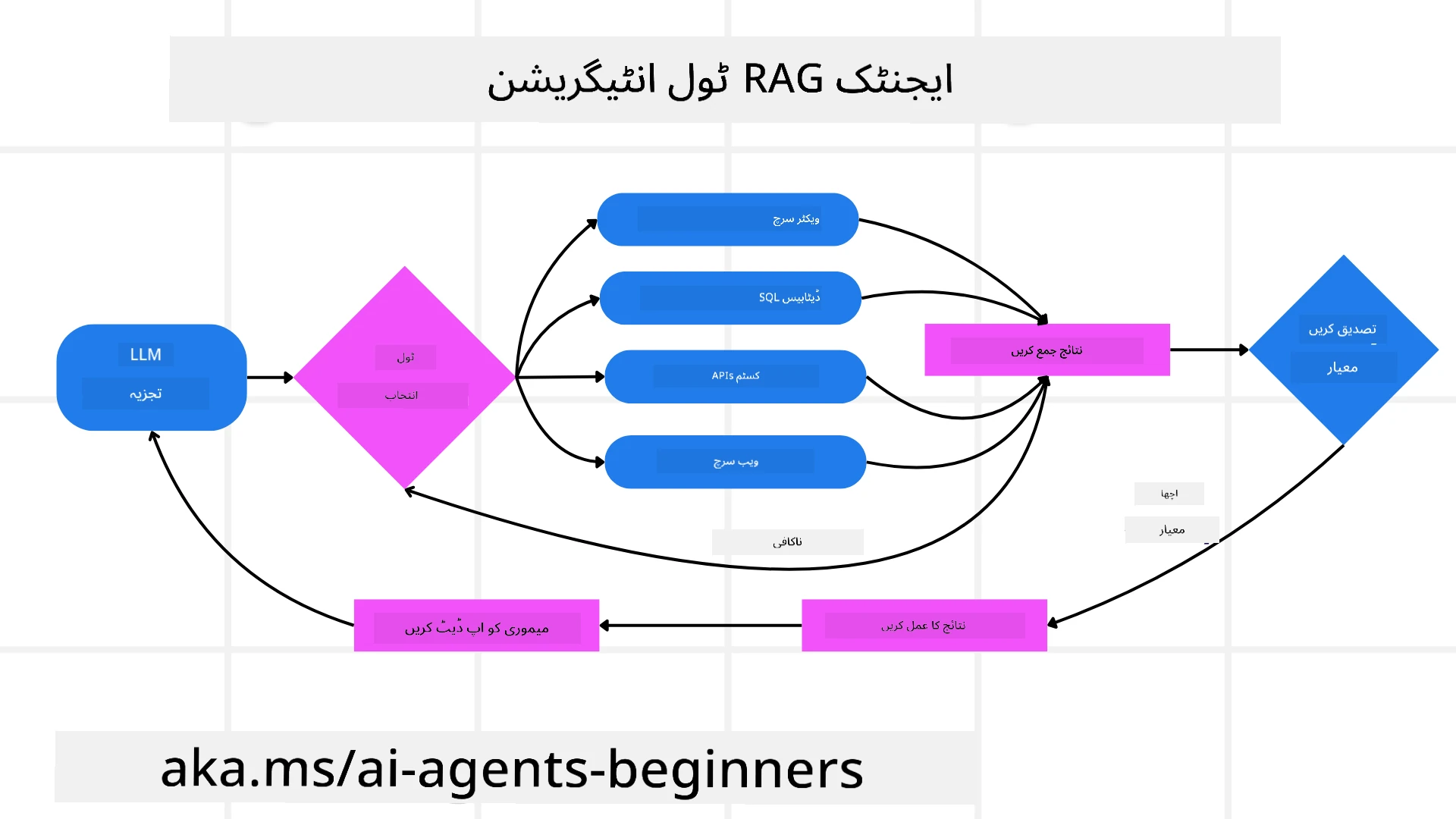

سسٹم فعال طور پر اپنے استدلالی عمل کا مالک بنتا ہے، ناکام ہونے والے سوالات کو دوبارہ لکھتا ہے، مختلف بازیافت کے طریقے منتخب کرتا ہے، اور متعدد ٹولز کو ضم کرتا ہے—جیسے Azure AI Search میں ویکٹر سرچ، SQL ڈیٹا بیس، یا کسٹم APIs—اپنا جواب حتمی شکل دینے سے پہلے۔ ایک agentic سسٹم کی نمایاں خصوصیت اس کی صلاحیت ہے کہ وہ اپنے استدلالی عمل کا مالک ہو۔ روایتی RAG نفاذات پہلے سے طے شدہ راستوں پر انحصار کرتے ہیں، مگر ایک agentic سسٹم خود بخود معلومات کے معیار کی بنیاد پر اقدامات کے تسلسل کو طے کرتا ہے۔

Agentic Retrieval-Augmented Generation (Agentic RAG) کی تعریف

Agentic Retrieval-Augmented Generation (Agentic RAG) AI ڈیولپمنٹ میں ایک ابھرتا ہوا پیراڈائم ہے جہاں LLMs نہ صرف بیرونی ڈیٹا ذرائع سے معلومات کھینچتے ہیں بلکہ خود مختار طریقے سے اپنے اگلے اقدامات کی منصوبہ بندی بھی کرتے ہیں۔ جامد retrieval-then-read پیٹرن یا محتاط طور پر اسکرپٹ شدہ پرامپٹ تسلسل کے برخلاف، Agentic RAG میں LLM کو تکراری طور پر کالز دی جاتی ہیں، جن کے بیچ ٹول یا فنکشن کالز اور ساختی آؤٹ پٹس شامل ہوتے ہیں۔ ہر موڑ پر، سسٹم حاصل کردہ نتائج کا جائزہ لیتا ہے، فیصلہ کرتا ہے کہ آیا سوالات کو بہتر بنانا ضروری ہے، ضرورت پڑنے پر اضافی ٹولز متحرک کرتا ہے، اور اس سائیکل کو جاری رکھتا ہے جب تک کہ ایک اطمینان بخش حل حاصل نہ ہو۔

یہ تکراری “maker-checker” آپریشن کا انداز درستگی کو بہتر بنانے، ساختی ڈیٹا بیسز (مثلاً NL2SQL) کے لیے خراب شدہ سوالات کو سنبھالنے، اور متوازن، اعلیٰ معیار کے نتائج کو یقینی بنانے کے لیے ڈیزائن کیا گیا ہے۔ محض محتاط طور پر تیار کردہ پرامپٹ چینز پر انحصار کرنے کے بجائے، سسٹم فعال طور پر اپنے استدلالی عمل کا مالک بنتا ہے۔ یہ ناکام ہونے والے سوالات کو دوبارہ لکھ سکتا ہے، مختلف بازیافت کے طریقے چن سکتا ہے، اور متعدد ٹولز کو یکجا کر سکتا ہے—جیسے Azure AI Search میں ویکٹر سرچ، SQL ڈیٹا بیسز، یا کسٹم APIs—اپنا جواب حتمی شکل دینے سے پہلے۔ اس سے ضرورت سے زیادہ پیچیدہ آرکسٹریشن فریم ورکس کی ضرورت ختم ہو جاتی ہے۔ اس کے بجائے، ایک نسبتاً سادہ لوپ “LLM کال → ٹول استعمال → LLM کال → …” مہارت یافتہ اور بنیاد پرست آؤٹ پٹس دے سکتا ہے۔

استدلالی عمل کا مالک ہونا

کسی سسٹم کو “agentic” بنانے والی نمایاں خصوصیت یہ ہے کہ وہ اپنے استدلالی عمل کا مالک بنتا ہے۔ روایتی RAG نفاذات اکثر ماڈل کے لیے انسان کی جانب سے ایک راستہ پہلے سے متعین کرنے پر منحصر ہوتی ہیں: ایک chain-of-thought جو بتاتی ہے کہ کب اور کیا حاصل کرنا ہے۔ لیکن جب ایک سسٹم واقعی agentic ہوتا ہے، تو وہ اندرونی طور پر یہ فیصلہ کرتا ہے کہ مسئلے کو کیسے حل کرنا ہے۔ یہ صرف کسی اسکرپٹ کو انجام نہیں دے رہا؛ یہ خود مختار طریقے سے معلومات کے معیار کی بنیاد پر اقدامات کے سلسلے کا تعین کر رہا ہے۔ مثال کے طور پر، اگر اسے پروڈکٹ لانچ اسٹریٹیجی بنانے کو کہا جائے، تو یہ پورے ریسرچ اور فیصلہ سازی کے ورک فلو کو واضح کرنے والے پرامپٹ پر ہی انحصار نہیں کرے گا۔ اس کے بجائے، agentic ماڈل خود مختار طور پر فیصلہ کرے گا کہ:

- Bing Web Grounding کے ذریعے موجودہ مارکیٹ ٹرینڈ رپورٹس حاصل کرے

- Azure AI Search استعمال کرتے ہوئے متعلقہ حریف کا ڈیٹا شناخت کرے۔

- Azure SQL Database استعمال کرتے ہوئے تاریخی اندرونی سیلز میٹرکس کو جوڑے۔

- Azure OpenAI Service کے ذریعے نتائج کو یکجا کر کے ایک مربوط حکمتِ عملی تیار کرے۔

- حکمتِ عملی میں خالی جگہوں یا تضادات کے لیے جائزہ لے، اور اگر ضروری ہو تو دوبارہ بازیابی کی ایک اور دوری کا مطالبہ کرے۔ یہ تمام اقدامات—سوالات کو بہتر بنانا، ماخذوں کا انتخاب، جواب سے “خوش” ہونے تک تکرار کرنا—ماڈل کے ذریعے طے کیے جاتے ہیں، نہ کہ کسی انسان کی جانب سے پہلے سے اسکرپٹ کیے گئے ہوں۔

تکراری لوپس، ٹول انضمام، اور میموری

ایک agentic سسٹم لوپڈ انٹرایکشن پیٹرن پر انحصار کرتا ہے:

- ابتدائی کال: صارف کا ہدف (یعنی صارف کا پرامپٹ) LLM کے سامنے پیش کیا جاتا ہے۔

- ٹول کا استعمال: اگر ماڈل کسی گمشدہ معلومات یا غیر واضح ہدایات کا پتہ لگاتا ہے، تو وہ ایک ٹول یا بازیافت کے طریقے کا انتخاب کرتا ہے—جیسے ویکٹر ڈیٹا بیس کو استفسار کرنا (مثلاً Azure AI Search Hybrid تلاش نجی ڈیٹا پر) یا مزید سیاق و سباق جمع کرنے کے لیے ایک ساختی SQL کال۔

- جائزہ اور اصلاح: واپسی شدہ ڈیٹا کا جائزہ لینے کے بعد، ماڈل فیصلہ کرتا ہے کہ آیا معلومات کافی ہیں۔ اگر نہیں، تو وہ سوال کو بہتر بناتا ہے، کوئی مختلف ٹول آزمانے کی کوشش کرتا ہے، یا اپنے نقطۂ نظر کو ایڈجسٹ کرتا ہے۔

- اطمینان تک دہرائیں: یہ سائیکل جاری رہتا ہے جب تک ماڈل یہ تعین نہ کر لے کہ اس کے پاس ایک حتمی، اچھے استدلال والا جواب دینے کے لیے کافی واضح معلومات اور شواہد موجود ہیں۔

- میموری اور اسٹیٹ: چونکہ سسٹم اقدامات کے دوران ریاست اور میموری برقرار رکھتا ہے، اس لیے وہ پچھلے کوششوں اور ان کے نتائج کو یاد رکھ سکتا ہے، بار بار دہرانے سے بچتا ہے اور آگے بڑھتے ہوئے زیادہ معلوماتی فیصلے کرتا ہے۔

وقت کے ساتھ، یہ سمجھ میں بتدریج اضافہ پیدا کرتا ہے، ماڈل کو پیچیدہ، کثیر-مرحلہ کاموں کو بغیر مستقل انسانی مداخلت یا پرامپٹ کو بار بار تبدیل کیے بغیر نیویگیٹ کرنے کے قابل بناتا ہے۔

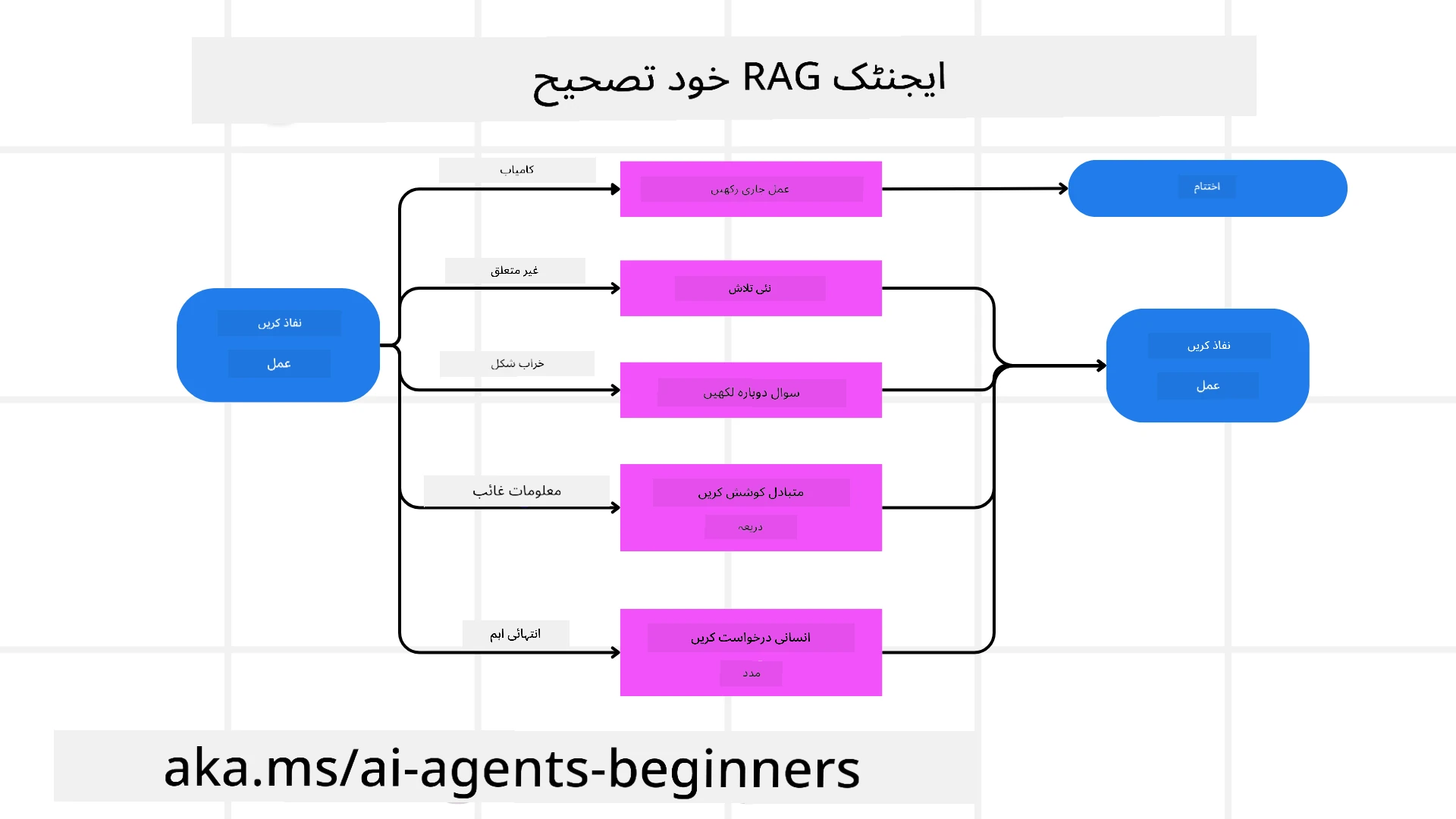

ناکامی کے موڈز اور خود درستگی کو سنبھالنا

Agentic RAG کی خود مختاری میں مضبوط خود درستگی میکانزمز بھی شامل ہیں۔ جب سسٹم بند گلیاں مارے—جیسے نامناسب دستاویزات بازیافت کرنا یا خراب شدہ سوالات کا سامنا—تو یہ کر سکتا ہے:

- تکرار اور دوبارہ استفسار: کم قدر والے جوابات واپس کرنے کے بجائے، ماڈل نئی تلاش حکمتِ عملیاں آزمانے، ڈیٹا بیس سوالات کو دوبارہ لکھنے، یا متبادل ڈیٹا سیٹس دیکھنے کی کوشش کرتا ہے۔

- تشخیصی ٹولز کا استعمال: سسٹم اضافی فنکشنز کو متحرک کر سکتا ہے جو اس کے استدلالی اقدامات کو ڈیبگ کرنے یا بازیافت شدہ ڈیٹا کی درستگی کی تصدیق میں مدد دیتے ہیں۔ Azure AI Tracing جیسے ٹولز مضبوط مشاہدہ اور مانیٹرنگ کو فعال کرنے میں اہم ہوں گے۔

- انسانی نگرانی پر انحصار: اعلیٰ رسک یا بار بار ناکام ہونے والے منظرناموں کے لیے، ماڈل غیر یقینی صورتحال کی نشاندہی کر کے انسانی رہنمائی کا مطالبہ کر سکتا ہے۔ ایک بار جب انسان اصلاحی فیڈبیک فراہم کرتا ہے، ماڈل اس سبق کو مستقبل میں شامل کر سکتا ہے۔

یہ تکراری اور متحرک طریقہ کار ماڈل کو مسلسل بہتر بننے کی اجازت دیتا ہے، اس بات کو یقینی بناتے ہوئے کہ یہ محض ایک ون-شاٹ سسٹم نہ ہو بلکہ ایک ایسا نظام ہو جو سیشن کے دوران اپنی غلطیوں سے سیکھے۔

ایجنسی کی حدیں

کسی کام کے اندر اس کی خود مختاری کے باوجود، Agentic RAG عام فہم مصنوعی ذہانت (Artificial General Intelligence) کے مترادف نہیں ہے۔ اس کی “agentic” صلاحیتیں ان ٹولز، ڈیٹا ذرائع، اور پالیسیاں تک محدود ہیں جو انسانی ڈیولپرز نے فراہم کی ہیں۔ یہ اپنے اوزار خود ایجاد نہیں کر سکتا یا اس ڈومین کی حدود سے باہر قدم نہیں بڑھا سکتا جو مقرر کی گئی ہیں۔ بلکہ، یہ دستیاب وسائل کو متحرک انداز میں منظم کرنے میں مہارت رکھتا ہے۔ مزید جدید AI اشکال سے کلیدی فرق شامل ہیں:

- ڈومین مخصوص خود مختاری: Agentic RAG سسٹمز معروف ڈومین کے اندر صارف کی متعین کردہ اہداف حاصل کرنے پر مرکوز ہوتے ہیں، نتائج کو بہتر بنانے کے لیے سوالات دوبارہ لکھنے یا ٹول منتخب کرنے جیسی حکمتِ عملیاں اپناتے ہیں۔

- انفراسٹرکچر پر انحصار: سسٹم کی صلاحیتیں ان ٹولز اور ڈیٹا پر منحصر ہوتی ہیں جو ڈیولپرز نے یکجا کیے ہیں۔ یہ انسانی مداخلت کے بغیر ان حدود سے تجاوز نہیں کر سکتا۔

- گارڈ ریلز کا احترام: اخلاقی ہدایات، تعمیل کے قواعد، اور کاروباری پالیسیاں بہت اہم رہتی ہیں۔ ایجنٹ کی آزادی ہمیشہ حفاظتی اقدامات اور نگرانی کے طریقہ کار سے محدود ہوتی ہے (امید ہے؟)

عملی استعمال کے معاملات اور قدر

Agentic RAG ان منظرناموں میں بہترین کام کرتا ہے جن میں تکراری بہتری اور درستگی کی ضرورت ہو:

- درستگی-اول ترجیحات والے ماحول: تعمیلی چیکس، ضوابطی تجزیہ، یا قانونی تحقیق میں، agentic ماڈل حقائق کی بار بار توثیق کر سکتا ہے، متعدد ماخذ مشاورت کر سکتا ہے، اور سوالات کو اس وقت تک دوبارہ لکھ سکتا ہے جب تک کہ وہ مکمل طور پر جانچ شدہ جواب فراہم نہ کرے۔

- پیچیدہ ڈیٹا بیس تعاملات: جب ساختی ڈیٹا کے ساتھ معاملہ ہو جہاں سوالات اکثر ناکام ہو سکتے ہیں یا ایڈجسٹمنٹ کی ضرورت ہو سکتی ہے، تو سسٹم خود مختار طور پر اپنے سوالات Azure SQL یا Microsoft Fabric OneLake استعمال کرتے ہوئے بہتر کر سکتا ہے، اس بات کو یقینی بناتے ہوئے کہ حتمی بازیافت صارف کے ارادے کے مطابق ہو۔

- طویل ورک فلو: طویل دورانیے کے سیشن وقت کے ساتھ نئے معلومات سامنے آنے پر تبدیل ہو سکتے ہیں۔ Agentic RAG مسلسل نئے ڈیٹا کو شامل کر سکتا ہے، اور مسئلے کی جگہ کے بارے میں مزید جاننے پر حکمتِ عملی تبدیل کرتا رہتا ہے۔

گورننس، شفافیت، اور اعتماد

جب یہ سسٹمز اپنے استدلال میں زیادہ خود مختار بنتے ہیں، تو گورننس اور شفافیت بہت اہم ہو جاتے ہیں:

- قابل وضاحت استدلال: ماڈل وہ سوالات، ماخذ جن سے مشاورت کی گئی، اور نتیجہ تک پہنچنے کے لیے اختیار کیے گئے استدلالی اقدامات کا آڈٹ ٹریل فراہم کر سکتا ہے۔ Azure AI Content Safety اور Azure AI Tracing / GenAIOps جیسے ٹولز شفافیت برقرار رکھنے اور خطرات کو کم کرنے میں مدد دے سکتے ہیں۔

- تعصب کنٹرول اور متوازن بازیافت: ڈیولپرز بازیافت حکمتِ عملیاں ایڈجسٹ کر سکتے ہیں تاکہ متوازن، نمائندہ ڈیٹا ذرائع کو یقینی بنایا جا سکے، اور وسیع ڈیٹا سائنس تنظیموں کے لیے Azure Machine Learning استعمال کرتے ہوئے آؤٹ پٹس کا باقاعدگی سے آڈٹ کر کے تعصب یا یکطرفہ پیٹرنز کا پتہ لگا سکیں۔

- انسانی نگرانی اور تعمیل: حساس کاموں کے لیے، انسانی تجزیہ لازمی رہتا ہے۔ Agentic RAG اعلیٰ رسک فیصلوں میں انسانی حکمی کو بدلتا نہیں—یہ اسے ایسے آپشنز دے کر مضبوط بناتا ہے جو زیادہ مکمل جانچے ہوئے ہوں۔

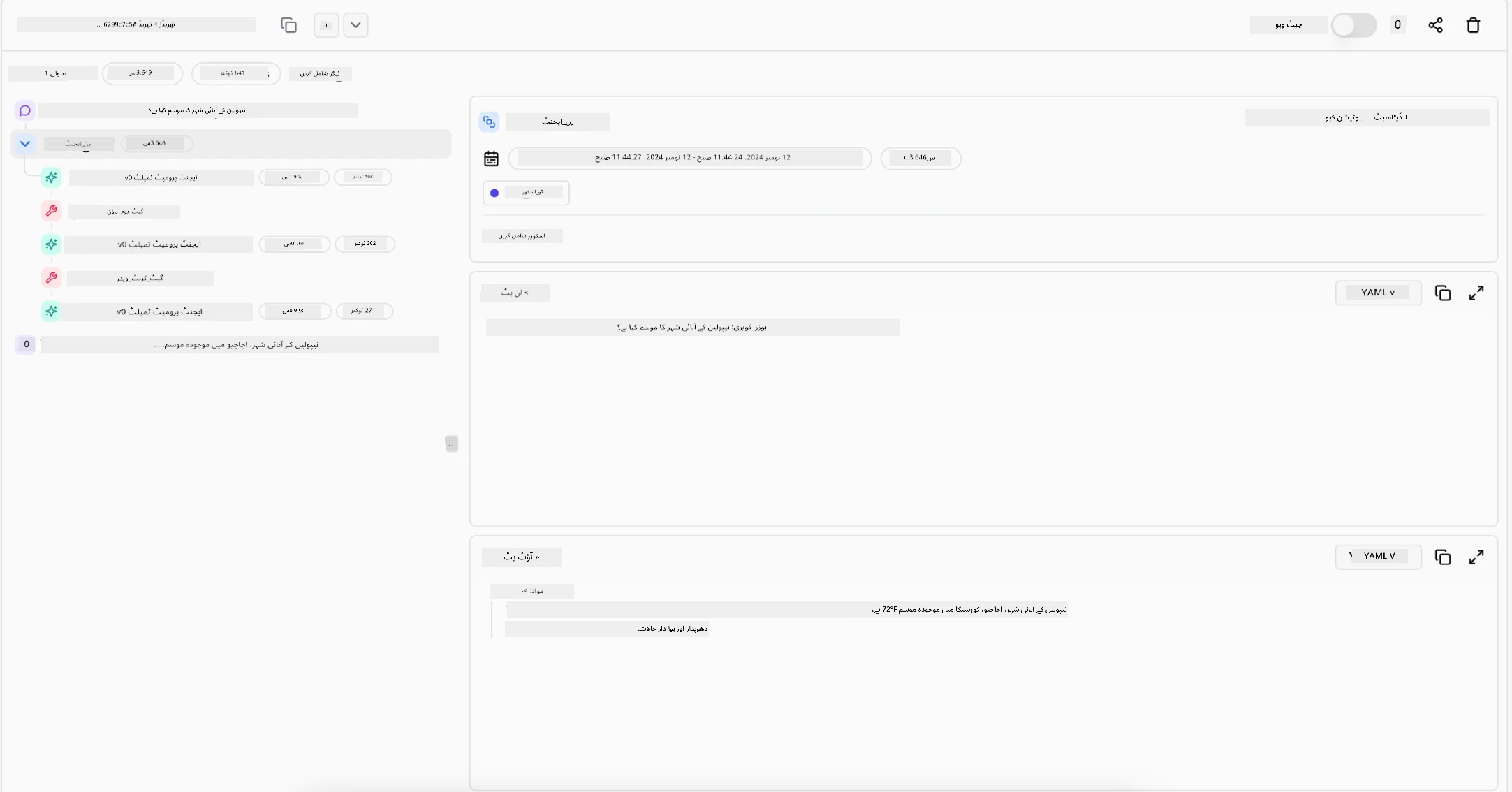

ایسے ٹولز کا ہونا جو اقدامات کا واضح ریکارڈ فراہم کریں ناگزیر ہے۔ ان کے بغیر، ایک کثیر مرحلہ عمل کو ڈیبگ کرنا بہت مشکل ہو سکتا ہے۔ Literal AI (جس کمپنی کے پیچھے Chainlit ہے) کی ایک مثال میں Agent run دیکھیں:

نتیجہ

Agentic RAG اس بات کی ایک فطری ارتقاء کی نمائندگی کرتا ہے کہ AI سسٹمز پیچیدہ، ڈیٹا سے بھرپور کاموں کو کیسے سنبھالتے ہیں۔ لوپڈ انٹرایکشن پیٹرن اپنانے، خود مختار طور پر ٹولز کے انتخاب، اور اعلیٰ معیار کے نتیجے تک پہنچنے تک سوالات کو بہتر بنانے کے ذریعے، سسٹم جامد پرامپٹ فالو کرنے سے آگے بڑھ کر ایک زیادہ موافق، سیاق و سباق سے باخبر فیصلہ ساز بن جاتا ہے۔ حالانکہ یہ اب بھی انسانی متعین کردہ انفراسٹرکچر اور اخلاقی ہدایات سے محدود ہے، یہ agentic صلاحیتیں اداروں اور اختتامی صارفین دونوں کے لیے زیادہ بھرپور، زیادہ متحرک، اور آخرکار زیادہ مفید AI تعاملات کو ممکن بناتی ہیں۔

Agentic RAG کے بارے میں مزید سوالات ہیں؟

مزید سیکھنے والوں سے ملنے، آفس آورز میں شرکت کرنے اور اپنے AI Agents کے سوالات کے جواب حاصل کرنے کے لیے Microsoft Foundry Discord میں شامل ہوں۔

اضافی وسائل

- Azure OpenAI Service کے ساتھ Retrieval Augmented Generation (RAG) کو نافذ کریں: جانیں کہ اپنی ڈیٹا کو Azure OpenAI Service کے ساتھ کیسے استعمال کریں۔ یہ Microsoft Learn ماڈیول RAG کو نافذ کرنے کے بارے میں جامع رہنمائی فراہم کرتا ہے

- Microsoft Foundry کے ساتھ جنریٹو AI ایپلیکیشنز کا جائزہ: یہ مضمون عوامی طور پر دستیاب ڈیٹاسیٹس پر ماڈلز کے جائزہ اور موازنہ کو کور کرتا ہے، بشمول Agentic AI ایپلیکیشنز اور RAG آرکیٹیکچرز

- Agentic RAG کیا ہے | Weaviate

- Agentic RAG: ایجنٹ پر مبنی ریٹریول آگمینٹڈ جنریشن کے لیے مکمل رہنما – generation RAG سے خبریں

- Agentic RAG: استفسار کی ازسرِ نو تشکیل اور خود-استفسار کے ساتھ اپنے RAG کو تیز کریں! Hugging Face اوپن سورس AI Cookbook

- RAG میں Agentic پرتیں شامل کرنا

- علمی معاونین کا مستقبل: Jerry Liu

- Agentic RAG سسٹمز کیسے بنائیں

- اپنے AI ایجنٹس کو اسکیل کرنے کے لیے Microsoft Foundry Agent Service کا استعمال

تعلیمی مقالے

- 2303.17651 Self-Refine: خود فیڈبیک کے ساتھ تکراری اصلاح

- 2303.11366 Reflexion: زبانی ری انفورسمنٹ لرننگ کے ساتھ زبان ایجنٹس

- 2305.11738 CRITIC: بڑے لینگویج ماڈلز ٹول-انٹرایکٹو تنقید کے ذریعے خود درست کر سکتے ہیں

- 2501.09136 Agentic Retrieval-Augmented Generation: Agentic RAG پر ایک سروے

پچھلا سبق

اگلا سبق

ردِ ذمہ داری: یہ دستاویز AI ترجمہ سروس Co‑op Translator (https://github.com/Azure/co-op-translator) کے ذریعے ترجمہ کی گئی ہے۔ اگرچہ ہم درستگی کی بھرپور کوشش کرتے ہیں، براہِ کرم آگاہ رہیں کہ خودکار تراجم میں غلطیاں یا عدم درستیاں ہو سکتی ہیں۔ اصل دستاویز اپنی مادری زبان میں ہی مستند ذریعہ سمجھی جانی چاہیے۔ اہم معلومات کے لیے پیشہ ور انسانی ترجمہ کی سفارش کی جاتی ہے۔ ہم اس ترجمہ کے استعمال سے پیدا ہونے والی کسی بھی غلط فہمی یا غلط تعبیر کے لیے ذمہ دار نہیں ہیں۔